Apr 30, 2026

Eduardo Mangarelli

Los sistemas de IA transforman la forma en que las organizaciones sirven a sus clientes, operan y compiten. La señal más relevante combina avance técnico, velocidad de maduración y llegada de capacidades concretas a productos y procesos reales. Para quienes toman decisiones, el desafío principal pasa por comprender cómo funcionan estos sistemas, qué dependencias generan, dónde conviene adoptar soluciones existentes, dónde desarrollar capacidades propias y cómo traducir su potencial en valor efectivo. En este contexto, el conocimiento tecnológico y la capacidad de aprendizaje de personas y organizaciones se vuelven condiciones centrales para decidir con criterio y actuar a tiempo.

Call to action: Desarrollar hoy el conocimiento tecnológico, el criterio directivo y la capacidad organizacional que permitan convertir los sistemas de IA Generativa en ventaja real.

Los sistemas de IA Generativa (IA) avanzan a una velocidad que exige interpretación activa y decisiones con criterio. La diferencia entre las organizaciones que capturan valor y las que sólo siguen la conversación está en su capacidad de distinguir qué cambio es estructural, qué fenómeno es transitorio y qué capacidad puede convertirse en ventaja real.

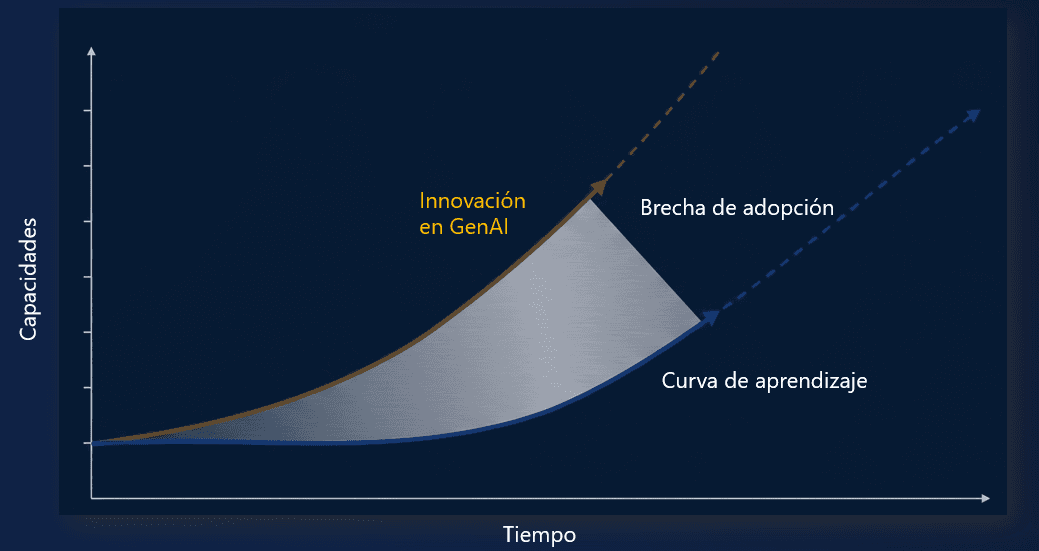

La aceleración actual tiene un motor claro: inversión masiva a lo largo del ecosistema de IA. Su efecto principal es la compresión del tiempo. Capacidades que antes habrían tardado años en madurar están llegando en meses, con más velocidad de iteración y despliegue. Un ejemplo visible es la evolución reciente de estos sistemas: en un período muy corto pasaron de desempeñarse principalmente como interfaces conversacionales a empezar a resolver tareas más complejas, como programar, analizar grandes volúmenes de información, operar sobre múltiples herramientas y ejecutar secuencias de trabajo de varios pasos. Lo que hace poco tiempo pertenecía al terreno de la demostración empieza a aparecer como capacidad disponible en productos concretos. Eso modifica el marco de decisión. La tecnología avanza más rápido que la capacidad interna de adopción natural. Por eso, el problema ya no es sólo tecnológico. Es también un problema de velocidad organizacional. Muchas organizaciones siguen evaluando estas capacidades con ritmos anteriores, mientras el entorno competitivo cambia con otra velocidad.

Entender cómo funcionan estos sistemas deja de ser un lujo técnico y pasa a ser una condición para decidir mejor. Los tokens son su unidad operativa: articulan lenguaje, cómputo y costo. Un token puede entenderse, de forma simplificada, como una unidad mínima de texto que el sistema procesa. A partir de ahí se organiza toda la cadena: datos, entrenamiento, modelo e inferencia. La inferencia es la etapa en la que un modelo ya entrenado se utiliza efectivamente para producir resultados: responder una consulta, generar un informe, resumir un documento o ejecutar una tarea. Es en la inferencia donde se concentra el uso real y donde se vuelve visible una parte decisiva de la estructura de costos, márgenes y escala. Esto tiene implicancias concretas. Una organización puede decidir no entrenar un modelo propio y utilizar, en cambio, capacidades disponibles a través de un proveedor externo. En ese caso, el costo principal ya no está en construir el modelo, sino en cada uso efectivo del sistema: en cada consulta, en cada documento procesado, en cada workflow automatizado. Esa comprensión permite decidir mejor qué adoptar, qué tercerizar y qué conviene controlar.

Por otro lado, la infraestructura se ha convertido en una variable estratégica. Las empresas que controlan chips, energía, redes y capacidad de cómputo ocupan una posición distinta de aquellas que dependen completamente de terceros. Para la mayoría de las organizaciones, el punto no es construir esa infraestructura, sino entender las dependencias que aceptan al elegir una plataforma. Una organización puede tercerizar el acceso a modelos fundacionales a través de la nube y concentrar sus esfuerzos en aquello que sí la diferencia: sus datos, sus procesos, sus interfaces y sus mecanismos de control. Pero también puede decidir que ciertas capas no deberían quedar completamente externalizadas, por ejemplo, la integración con sistemas internos, la gestión de información sensible, la lógica de supervisión humana o la orquestación de agentes sobre procesos críticos. La pregunta no es simplemente qué comprar y qué construir. La pregunta es dónde reside la diferenciación real y qué dependencia futura se está aceptando al resolver esa pregunta.

El cambio más relevante en curso es el paso de sistemas que responden preguntas a sistemas que ejecutan tareas.

Los agentes autónomos combinan modelos, herramientas, memoria y contexto para alcanzar objetivos y ajustar su comportamiento durante la ejecución. La diferencia es práctica: una herramienta mejora tareas puntuales; un agente autónomo puede transformar la operación de una función completa. Un ejemplo sencillo permite ver esa diferencia. No es lo mismo utilizar un sistema para redactar un correo, resumir una reunión o responder una consulta puntual, que utilizar un agente para monitorear una casilla de entrada, clasificar mensajes, extraer datos relevantes, actualizar otro sistema y escalar excepciones a una persona cuando corresponde. En el primer caso hay asistencia. En el segundo empieza a haber rediseño operativo. Y ese punto importa especialmente a quienes toman decisiones, porque marca el momento en que la conversación deja de ser sobre productividad individual y empieza a ser sobre estructura operativa, asignación de recursos y rediseño de procesos.

El principal cuello de botella hoy no está en la tecnología, sino en la adopción. La brecha decisiva sigue siendo la distancia entre lo que estos sistemas ya son capaces de hacer y lo que las organizaciones logran implementar con efectividad y transformar en valor.

En ese contexto, la capacitación a nivel personal y organizacional deja de ocupar un lugar periférico. Pasa a ser una condición de adaptación. Las personas necesitan desarrollar el conocimiento necesario para trabajar con estos sistemas con criterio, entendiendo su lógica, su alcance y sus límites. Las organizaciones necesitan convertir ese conocimiento en capacidad colectiva: lenguaje común, mejores decisiones, adaptación de procesos y adopción más efectiva. No se trata solamente de enseñar a usar herramientas. Se trata de desarrollar criterio para decidir cuándo confiar, cuánto iterar, cuándo supervisar, cuándo rediseñar un proceso y cuándo una aparente innovación todavía no justifica un cambio operativo real.

En una etapa de cambio tecnológico acelerado, aprender más rápido y con mayor profundidad empieza a ser una forma concreta de competir.

La ventaja no proviene solo del acceso a nuevas herramientas. Proviene, cada vez más, de la capacidad de comprenderlas, integrarlas y usarlas con juicio. En esa capacidad de aprendizaje —individual y organizacional— empieza a definirse una parte creciente de la diferencia entre adoptar tecnología y traducirla en resultado.

Para quienes toman decisiones, la conclusión no debería quedarse en el diagnóstico. Debería traducirse en una agenda concreta. El primer ejercicio es interno: qué procesos ya pueden capturar valor hoy, sin esperar la próxima generación tecnológica, y qué conocimiento falta en los equipos directivos y operativos para adoptar con criterio. El segundo es estratégico: qué dependencias se están aceptando al elegir proveedores y plataformas, y dónde reside la diferenciación real. El tercero es de medición: qué casos de uso justifican adoptar soluciones existentes, cuáles ameritan construir capacidad propia y bajo qué métricas se va a distinguir experimentación de impacto real.

El foco de las organizaciones y de las personas debe estar en desarrollar la capacidad de comprender el impacto de los sistemas de IA a partir de conocimiento tecnológico, con suficiente profundidad y anticipación como para traducir esa lectura en decisiones concretas.